Les Hatton

Emeritus Professor of Computer Science, Kingston University, UK

Il lavoro di Les Hatton si inserisce in un filone argomentativo che tenta di contestualizzare l’attuale riscaldamento globale confrontandolo con la variabilità naturale del clima ricostruita dai grandi archivi paleoclimatici. L’autore assume come punto di partenza il valore di circa 1,1 °C di aumento della temperatura media globale rispetto al periodo 1850–1900, un valore che l’IPCC attribuisce in modo inequivocabile alle attività umane, principalmente attraverso l’aumento dei gas serra, e che costituisce oggi uno dei riferimenti centrali del dibattito climatico internazionale. Su questa base, il paper pone una domanda apparentemente semplice: un incremento di 1,1 °C in un secolo è un evento raro nella lunga storia climatica del Quaternario? Per rispondere, l’autore utilizza il dataset EPICA-Vostok, cioè un archivio isotopico antartico con risoluzione secolare che copre circa 800.000 anni, e conclude che, nell’interglaciale attuale, variazioni secolari di questa ampiezza non sarebbero affatto eccezionali, dal momento che circa il 16% dei secoli successivi all’ultima glaciazione mostrerebbe aumenti pari o superiori a tale soglia. Secondo Hatton, questo ridimensionerebbe l’idea che l’attuale riscaldamento sia “insolito” e renderebbe problematica una netta separazione tra componente antropica e componente naturale.

Tuttavia, proprio qui emerge il punto metodologico più delicato dell’intero studio. Il record EPICA-Dome C, in accordo con Vostok, rappresenta un archivio straordinario per ricostruire le grandi oscillazioni glaciali-interglaciali dell’Antartide e per investigare l’accoppiamento tra temperatura, gas serra, polveri e forcing orbitale lungo gli ultimi cicli climatici. La letteratura primaria sottolinea però che si tratta di un proxy locale antartico, ricavato dagli isotopi stabili dell’acqua nel ghiaccio, non di una misura diretta della temperatura media globale. Gli stessi studi di sintesi su EPICA evidenziano che il legame tra temperatura antartica e temperatura globale è forte ma non costante nel tempo, e che le intensità relative degli interglaciali dipendono anche da effetti regionali, stagionali, dinamiche glaciologiche e feedback propri dell’Antartide. Inoltre, lo stesso articolo di Hatton riconosce esplicitamente che l’Antartide potrebbe non essere rappresentativa della “global average temperature”, pur scegliendo di concentrarsi sul problema delle variazioni di temperatura in un dataset “puro” a stazione singola. Questa ammissione è cruciale, perché implica che il confronto proposto non avviene tra grandezze omogenee: da un lato una media globale strumentale, dall’altro una serie proxy locale.

In paleoclimatologia, infatti, la questione non è solo se un’oscillazione di ampiezza simile sia esistita in passato, ma a quale scala spaziale e temporale essa vada confrontata. Le transizioni glaciali-interglaciali registrate da EPICA mostrano cambiamenti molto grandi, ma inseriti in un sistema climatico dominato da forcing orbitali, calotte glaciali estese, livelli di gas serra differenti e una configurazione della circolazione oceanica e atmosferica profondamente diversa da quella olocenica e industriale. Per questo la letteratura più recente tende a confrontare il riscaldamento moderno non con una singola carota antartica, ma con ricostruzioni multiproxy globali o emisferiche. In questa direzione, la ricostruzione assimilativa di Osman et al. per gli ultimi 24.000 anni conclude che sia il tasso sia la magnitudine del riscaldamento moderno risultano inusuali rispetto al quadro paleoclimatico tardo-quaternario. Analogamente, le ricostruzioni oloceniche multi-metodo di Kaufman e colleghi, basate sul database Temperature 12k, mostrano che la ricostruzione della temperatura media globale richiede un’integrazione di proxy marini e continentali distribuiti spazialmente, proprio per evitare che un singolo archivio regionale venga impropriamente assunto come rappresentativo del segnale globale.

Anche sul piano storico più recente, le sintesi del progetto PAGES 2k e dell’IPCC offrono un quadro piuttosto diverso da quello suggerito dal paper. Le ricostruzioni continentali mostrano che l’aumento termico tra XIX e XX secolo ha superato quello osservato tra tutte le altre coppie di secoli consecutivi nella maggior parte delle regioni studiate, con eccezione di Antarctica e Sud America. L’IPCC AR6 aggiunge che la temperatura del decennio 2011–2020 ha raggiunto circa 1,1 °C sopra il livello 1850–1900 per effetto delle attività umane e che le temperature recenti superano, con livello di confidenza almeno medio, quelle del più caldo periodo multi-secolare degli ultimi 100.000 anni, collocato intorno a 6500 anni fa nell’Olocene. Ciò non significa che in passato non siano avvenuti rapidi aumenti regionali o transizioni naturali intense, ma significa che il confronto corretto richiede serie omogenee, risoluzioni compatibili e soprattutto una distinzione netta fra variabilità locale, variabilità emisferica e cambiamento medio globale.

In definitiva, il merito del lavoro di Hatton è quello di richiamare l’attenzione su un tema reale della climatologia storica, cioè la necessità di collocare il riscaldamento moderno dentro un contesto paleoclimatico ampio e di discutere con rigore il significato statistico della parola “insolito”. Tuttavia, la conclusione secondo cui l’attuale aumento non sarebbe nemmeno anomalo appare fragile, perché deriva da un confronto tra indicatori climatici non perfettamente equivalenti. Il record EPICA-Vostok è preziosissimo per studiare la dinamica glaciale-interglaciale antartica e i feedback del sistema climatico, ma non può essere utilizzato in modo lineare come controprova del fatto che l’attuale riscaldamento globale non sia eccezionale. La letteratura di sintesi più autorevole converge infatti su un punto diverso: la Terra ha certamente conosciuto nel passato grandi variazioni naturali, ma il riscaldamento globale osservato dall’era industriale, per rapidità, estensione e causa fisica dominante, si colloca fuori dal normale quadro di variabilità naturale dell’Olocene recente e risulta altamente anomalo nel contesto delle ricostruzioni globali disponibili.

Il significato climatico di un aumento di 1,1 °C in un secolo: tra attribuzione, proxy paleoclimatici e confronti con EPICA-Vostok

Il rapporto tra componente naturale e componente antropogenica del riscaldamento osservato nell’ultimo secolo rappresenta una delle questioni centrali della climatologia contemporanea. Nel dibattito pubblico le posizioni restano spesso polarizzate, ma la letteratura di attribuzione più autorevole ha ormai ristretto in modo sostanziale il campo dell’incertezza: l’IPCC afferma che l’influenza umana ha causato in modo inequivocabile il riscaldamento del sistema climatico e che la temperatura superficiale globale nel decennio 2011–2020 ha raggiunto circa 1,1 °C sopra il livello 1850–1900 per effetto delle attività umane. Gli aggiornamenti annuali di Forster e colleghi confermano inoltre che il riscaldamento indotto dall’uomo ha continuato ad aumentare a un ritmo senza precedenti nel record strumentale, arrivando a circa 0,27 °C per decennio nel periodo 2015–2024, mentre la variabilità interna del sistema climatico continua a modulare l’espressione interannuale e decadale del segnale senza però costituirne la causa dominante. In questo quadro, la domanda sul “quanto” del contributo antropico non può essere separata dal significato fisico e statistico della metrica utilizzata, cioè la temperatura media superficiale globale, che resta il principale indicatore sintetico del bilancio energetico e della risposta termica del sistema Terra.

Prima di discutere se un aumento di 1,1 °C in un secolo sia o meno “inusuale”, è necessario chiarire che cosa rappresenti davvero una temperatura media globale. Essa non coincide con la misura di un singolo termometro, ma con una grandezza integrata, ottenuta mediante reti osservative moderne e, per il passato remoto, tramite ricostruzioni multiproxy e metodi statistici di sintesi spaziale. Questa complessità, tuttavia, non rende la grandezza priva di significato; al contrario, ne definisce il carattere di indicatore climatico emergente, indispensabile per confrontare epoche diverse e per distinguere la variabilità regionale dal comportamento medio del pianeta. Gli studi del consorzio PAGES 2k mostrano che le ricostruzioni della temperatura globale degli ultimi due millenni, ottenute con molteplici metodi indipendenti, convergono nell’indicare che i maggiori trend di riscaldamento su scale di almeno vent’anni si collocano nella seconda metà del XX secolo. In modo analogo, la ricostruzione multi-metodo della temperatura media globale dell’Olocene realizzata da Kaufman e colleghi, così come la ricostruzione assimilativa globale di Osman e collaboratori per gli ultimi 24.000 anni, mostrano che il confronto corretto con il presente richiede archivi distribuiti globalmente e non il semplice ricorso a un singolo proxy locale, per quanto eccezionalmente lungo e ben risolto.

In questo contesto, le carote di ghiaccio EPICA e Vostok costituiscono un archivio paleoclimatico di valore straordinario, perché documentano l’evoluzione delle temperature antartiche e dei gas serra attraverso molteplici cicli glaciali-interglaciali. Il lavoro della comunità EPICA ha esteso il record antartico a circa 740.000 anni, poi portato a circa 800.000 anni con le ricostruzioni successive, mostrando la forte covariazione tra temperatura antartica e concentrazioni atmosferiche di CO₂ e CH₄ durante le grandi oscillazioni del Quaternario. Jouzel e colleghi hanno inoltre pubblicato per Dome C una ricostruzione termica dettagliata degli ultimi 800.000 anni, con valori medi secolari per la parte più recente del record, offrendo uno strumento eccezionale per studiare ampiezza, frequenza e struttura temporale delle variazioni climatiche antartiche. Tuttavia, la letteratura specialistica sottolinea anche un punto essenziale: il segnale isotopico delle carote antartiche è innanzitutto un proxy di temperatura regionale o locale, e il rapporto tra temperatura antartica e temperatura globale, pur essendo robusto su molte scale temporali, è influenzato da fattori specifici quali amplificazione polare, variazioni dell’elevazione della calotta, circolazione atmosferica e stagionalità del segnale isotopico. Per questo motivo, usare EPICA-Vostok come equivalente diretto della temperatura media globale richiede molta cautela metodologica.

La domanda scientificamente più solida, dunque, non è soltanto se un aumento di 1,1 °C in un secolo compaia da qualche parte in un record paleoclimatico “puro”, ma se un aumento di tale entità sia comparabile, per scala spaziale, contesto dinamico e condizioni al contorno, al riscaldamento globale osservato dall’epoca preindustriale. Durante le deglaciazioni del tardo Quaternario si sono certamente verificati cambiamenti rapidi e talora molto marcati, ma essi si sviluppavano in un sistema climatico sottoposto a forcing orbitali, grandi calotte glaciali, diversi livelli di gas serra e forti retroazioni criosferiche e oceaniche. Le ricostruzioni globali mostrano invece che nel quadro dell’Olocene e dell’epoca storica recente il riscaldamento contemporaneo emerge come eccezionale per coerenza spaziale, rapidità e causa dominante. L’IPCC sintetizza questo punto affermando che la scala dei cambiamenti recenti nel sistema climatico è senza precedenti da molti secoli a molti millenni, mentre gli studi PAGES 2k e Osman et al. indicano che il confronto corretto con il passato non attenua l’importanza dell’attribuzione, ma la rafforza, perché mostra che la variabilità naturale esiste, modula e talvolta amplifica, ma non spiega da sola il segnale globale moderno. Ne deriva che l’analisi dei record EPICA-Vostok è estremamente utile per contestualizzare la variabilità naturale di lungo periodo, ma non basta, da sola, a ridimensionare la centralità dell’attribuzione antropogenica nel riscaldamento attuale.

1.1 Dichiarazione di riproducibilità

La presenza di un pacchetto scaricabile contenente il dataset originale, insieme al software di analisi e di visualizzazione necessario a ricostruire tutte le figure e le conclusioni dello studio, colloca questo lavoro entro una tradizione metodologica ormai centrale nella scienza computazionale contemporanea: quella della riproducibilità computazionale. In questa prospettiva, un risultato scientifico non dovrebbe essere valutato soltanto per la sua coerenza teorica o per l’eleganza dell’interpretazione, ma anche per la possibilità che altri ricercatori possano rieseguire l’intera pipeline analitica, verificando in modo indipendente che gli stessi dati, gli stessi parametri e lo stesso codice conducano effettivamente ai medesimi esiti. Ince, Hatton e Graham-Cumming hanno sostenuto con forza che, in un contesto scientifico sempre più dipendente dal software, la semplice descrizione narrativa dei metodi non è più sufficiente, e che la disponibilità del codice sorgente costituisce una condizione essenziale per consentire un controllo autentico dei risultati pubblicati. In modo analogo, Peng ha osservato che la riproducibilità rappresenta uno standard minimo per la valutazione delle affermazioni scientifiche quando una replica completamente indipendente non sia immediatamente praticabile.

Alla luce di questa letteratura, la dichiarazione di riproducibilità contenuta nel paper assume un significato metodologico rilevante, perché segnala il tentativo di rendere l’analisi non soltanto leggibile, ma anche rieseguibile. Hatton e Warr, in un lavoro specificamente dedicato alla riproducibilità computazionale completa, hanno sottolineato che la trasparenza scientifica richiede la conservazione coordinata di dati, script, ambiente di esecuzione e procedure di generazione delle figure, così che il lettore possa ricostruire l’intero percorso dall’input grezzo all’output finale. Questo aspetto è particolarmente importante negli studi basati su dataset paleoclimatici o serie temporali lunghe, dove anche piccole scelte di preprocessing, filtraggio o rappresentazione grafica possono influenzare in modo sostanziale l’interpretazione dei risultati. La disponibilità di un pacchetto completo va quindi letta come un punto di forza del lavoro, perché riduce l’opacità del processo analitico e consente una verifica esterna più rigorosa.

Detto questo, la letteratura più recente mostra anche che la sola dichiarazione di disponibilità non garantisce automaticamente una riproduzione effettiva dei risultati. Lo studio empirico di Stodden, Seiler e Ma, condotto su articoli pubblicati in Science, ha evidenziato che le politiche basate sulla semplice disponibilità “su richiesta” di dati e codice producono risultati limitati: gli autori riuscirono a ottenere gli artefatti necessari solo in una parte dei casi, e la quota di lavori effettivamente riproducibili risultò ancora più ridotta. Per questo motivo, negli ultimi anni si è rafforzata l’idea che la riproducibilità richieda non solo l’accesso ai materiali, ma anche una loro organizzazione secondo principi standardizzati di documentazione, interoperabilità e riuso, come espresso dai principi FAIR per i dati scientifici e, più recentemente, dai principi FAIR4RS per il software di ricerca. In questo senso, la sottosezione del paper non è una semplice nota tecnica, ma rappresenta un passaggio epistemologicamente importante: essa dichiara che le conclusioni proposte possono essere sottoposte a verifica pubblica, condizione sempre più considerata essenziale per attribuire robustezza a un risultato scientifico, soprattutto quando esso entra in un dibattito altamente sensibile come quello climatico.

1 http://www.climatedata.info/proxies/data-downloads/, accessed 05-Dec-2025

2 https://leshatton.org/ClimateChangeCenturyRise.html, accessed 09-Dec-2025

1.2 Il dataset delle carote di ghiaccio EPICA-Vostok

Il dataset delle carote di ghiaccio EPICA-Vostok occupa una posizione centrale nella paleoclimatologia del Quaternario, perché fornisce uno degli archivi più lunghi, continui e metodologicamente coerenti oggi disponibili per ricostruire l’evoluzione del clima e della composizione atmosferica antartica. Il progetto EPICA (European Project for Ice Coring in Antarctica) fu concepito come un grande sforzo internazionale con l’obiettivo di ottenere due carotaggi profondi nell’Antartide orientale: uno presso Kohnen Station, pensato per una ricostruzione ad alta risoluzione di almeno un ciclo glaciale-interglaciale nel settore rivolto verso l’Atlantico, e uno presso Dome C, progettato invece per massimizzare la lunghezza temporale del record. In parallelo, il sito russo di Vostok aveva già fornito un archivio paleoclimatico di riferimento esteso a circa 420.000 anni, divenuto per molti anni il benchmark principale per lo studio delle relazioni tra temperatura antartica e gas serra. Il risultato più importante di EPICA è stato l’estensione di questo orizzonte temporale: il record di Dome C ha inizialmente documentato circa 740.000 anni di variabilità climatica, con buona concordanza rispetto a Vostok nelle porzioni sovrapposte, ed è stato poi pubblicato come serie isotopica e termica che si estende fino a circa 800.000 anni, diventando uno dei pilastri osservativi per lo studio degli ultimi otto cicli glaciali.

Dal punto di vista fisico, questi archivi non misurano direttamente la temperatura come farebbe un termometro moderno, ma la ricostruiscono attraverso proxy isotopici contenuti nel ghiaccio. In particolare, il rapporto isotopico del deuterio e dell’ossigeno nell’acqua del ghiaccio registra gli effetti del frazionamento isotopico lungo il ciclo idrologico e costituisce, in Antartide, un indicatore robusto delle condizioni termiche al momento della precipitazione. Per questa ragione, nei lavori EPICA il rapporto deuterio/idrogeno viene esplicitamente trattato come proxy della temperatura antartica, mentre le bolle d’aria intrappolate nel ghiaccio forniscono una registrazione diretta dei gas atmosferici del passato, inclusi CO₂ e CH₄. È importante sottolineare che le stime di temperatura derivate dal record di Dome C non sono semplici trascrizioni del segnale isotopico grezzo: il dataset pubblicato da Jouzel e Masson-Delmotte include infatti correzioni per la composizione isotopica dell’acqua marina e per le variazioni di elevazione della calotta glaciale, il che rende queste serie delle vere e proprie ricostruzioni paleotermiche calibrate su una scala cronologica dedicata. Ne deriva che il valore scientifico di EPICA-Vostok non risiede solo nella lunghezza del record, ma anche nella sua capacità di integrare informazione climatica, chimica atmosferica e cronologia glaciologica in un unico archivio stratificato.

Proprio per questo le carote antartiche restano uno degli strumenti più potenti per comprendere la dinamica climatica del Pleistocene superiore. Il record Vostok mostrò già alla fine degli anni Novanta che temperatura antartica, anidride carbonica e metano oscillavano in modo fortemente correlato attraverso quattro cicli glaciali-interglaciali, mentre EPICA permise di verificare che tale accoppiamento si estendeva ben oltre, offrendo un accesso senza precedenti alla struttura dei cicli climatici precedenti a 430.000 anni fa. Tuttavia, la letteratura specialistica ricorda anche i limiti interpretativi di questi archivi: si tratta innanzitutto di un segnale regionale antartico, non di una misura diretta della temperatura media globale; inoltre, la cronologia richiede modellizzazione del flusso del ghiaccio, stima del tasso di assottigliamento e correzione della differenza tra età del ghiaccio ed età del gas dovuta ai processi nel firn. Queste cautele non sminuiscono il valore del dataset, ma definiscono il corretto quadro epistemologico entro cui leggerlo: EPICA-Vostok rappresenta uno degli archivi più diretti e internamente coerenti del sistema climatico-atmosferico terrestre su scale di centinaia di migliaia di anni, pur rimanendo un osservatorio polare e non una media globale.

L’importanza di questo filone di ricerca è confermata dal fatto che esso non si è fermato al traguardo degli 800.000 anni. Il progetto Beyond EPICA – Oldest Ice, finanziato dalla Commissione europea e costruito proprio sull’eredità scientifica di EPICA, ha annunciato nel 2025 il raggiungimento del basamento a 2.800 metri presso Little Dome C e il recupero di un archivio climatico che si estende oltre 1,2 milioni di anni. Questo risultato promette di spingere ancora più indietro la frontiera osservativa, fino a intercettare in modo diretto la Mid-Pleistocene Transition, cioè la fase in cui i cicli glaciali della Terra passarono progressivamente da una dominante di circa 41.000 anni a una di circa 100.000 anni. In tal senso, il dataset EPICA-Vostok non è soltanto una testimonianza del passato, ma anche il fondamento su cui si sta costruendo la nuova generazione di archivi paleoclimatici profondi, destinati a ridefinire la nostra comprensione della variabilità naturale del clima terrestre su scale temporali estreme.

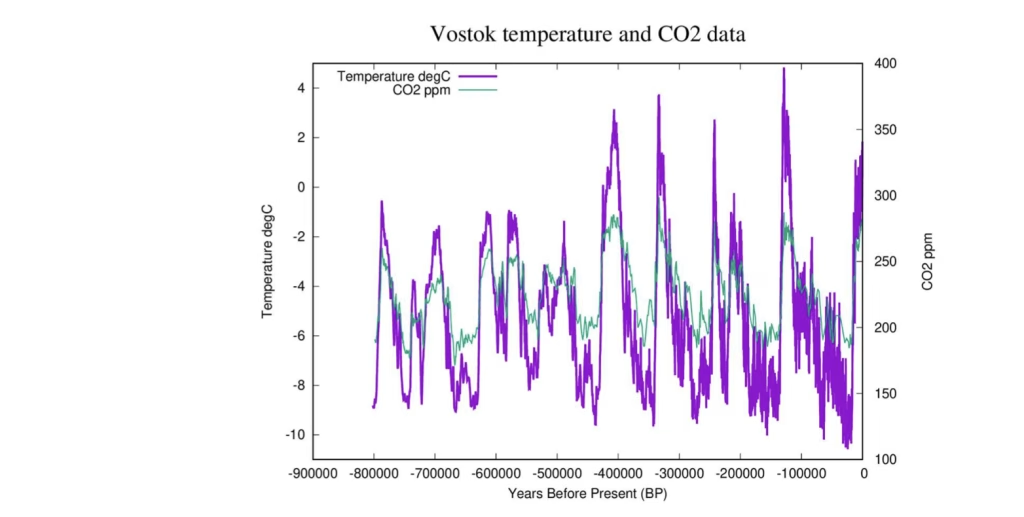

Figura 1. Temperatura e CO₂ nel record glaciale antartico: lettura paleoclimatica del dataset Vostok-EPICA

La figura 1 mostra in forma sintetica uno dei risultati più importanti della paleoclimatologia quaternaria: la stretta covariazione tra temperatura antartica ricostruita e concentrazione atmosferica di CO₂ lungo i grandi cicli glaciali-interglaciali. Sull’asse orizzontale è riportato il tempo in anni prima del presente (BP), fino a poco oltre 800.000 anni; sull’asse verticale sinistro compare la temperatura espressa come anomalia ricostruita in gradi Celsius, mentre sull’asse destro è riportata la CO₂ in ppm. La curva viola rappresenta la temperatura derivata dai proxy isotopici del ghiaccio, in particolare dal deuterio, mentre la curva verde rappresenta la CO₂ misurata nelle bolle d’aria intrappolate nel ghiaccio. Il messaggio visivo fondamentale del grafico è che, quando il clima antartico entra in una fase più calda, anche la CO₂ tende ad aumentare; quando invece il sistema scivola verso una fase glaciale, entrambe diminuiscono. Questo comportamento era già chiaramente emerso dal record classico di Vostok per gli ultimi 420.000 anni ed è stato poi confermato ed esteso dal carotaggio EPICA Dome C su una scala di circa 740.000–800.000 anni.

Dal punto di vista dinamico, la figura evidenzia la tipica struttura “a dente di sega” dei cicli climatici del tardo Quaternario: le deglaciazioni appaiono relativamente rapide, con impennate termiche e aumento dei gas serra, mentre il ritorno alle condizioni glaciali è generalmente più lento e graduale. Questa asimmetria è coerente con il quadro teorico in cui le variazioni orbitali modulano l’insolazione e innescano le transizioni, mentre i gas serra, la criosfera, l’oceano profondo e altri feedback interni del sistema climatico agiscono da amplificatori. La figura, quindi, non va letta come una semplice sovrapposizione di due curve simili, ma come la rappresentazione empirica di un sistema climatico fortemente accoppiato, nel quale la temperatura antartica e la composizione atmosferica evolvono in stretta relazione durante gli ultimi grandi cicli glaciali. Le analisi di sintesi sull’EPICA Dome C mostrano infatti che queste oscillazioni dominano il clima del tardo Quaternario su scale orbitali, e che il legame tra temperatura antartica e gas serra è una delle firme più robuste dell’archivio glaciale antartico.

È però essenziale interpretare correttamente la variabile termica mostrata nel grafico. La scala della temperatura, centrata attorno a valori compresi fra circa −10 e +5 °C, non rappresenta la temperatura assoluta dell’aria a Vostok, ma una ricostruzione relativa o un’anomalia ricavata dal segnale isotopico. Per questo il testo della figura precisa che, per trasformarla in una stima della temperatura superficiale assoluta, occorrerebbe applicare un offset di circa −55 °C. In altre parole, ciò che conta qui non è il valore assoluto, ma l’ampiezza delle oscillazioni. Un altro punto importante è che la figura, pur intitolata “Vostok temperature and CO2 data”, copre un intervallo temporale superiore al record Vostok classico: in senso stretto, infatti, il record pubblicato da Petit et al. si estende a circa 420.000 anni, mentre l’estensione verso 740.000–800.000 anni appartiene al record EPICA Dome C, che concorda bene con Vostok nella parte sovrapposta. Quindi la figura andrebbe interpretata più correttamente come una rappresentazione della grande archivistica glaciale antartica Vostok-EPICA, piuttosto che del solo carotaggio Vostok.

Sul piano scientifico, questa figura è importante perché rende immediatamente visibile che le grandi oscillazioni climatiche naturali del Pleistocene superiore non sono rumore casuale, ma presentano una struttura fisica coerente, scandita da cicli, soglie e feedback. Allo stesso tempo, la figura non autorizza da sola una trasposizione diretta alla temperatura media globale moderna, perché il segnale isotopico delle carote antartiche resta innanzitutto un proxy regionale antartico. Proprio per questo, nella letteratura specialistica Vostok ed EPICA sono considerati archivi fondamentali per comprendere la variabilità naturale e l’accoppiamento clima-gas serra, ma devono essere integrati con altri proxy e con ricostruzioni multiproxy globali quando si vogliono trarre conclusioni sulla scala planetaria. Letta correttamente, la figura 1 è quindi un eccellente compendio della storia climatica antartica degli ultimi otto cicli glaciali: mostra la potenza dei carotaggi polari, la coerenza del legame tra temperatura e CO₂ e, insieme, la necessità di distinguere sempre tra clima regionale, segnale polare e media globale.

2.1 L’intero dataset attuale: da 800.000 anni fa a oggi

L’osservazione dell’intero archivio EPICA-Vostok mostra che il clima del tardo Quaternario è stato dominato da una successione di lunghi stadi glaciali intervallati da interglaciali relativamente brevi, con una forte periodicità prossima ai 100.000 anni. Per la maggior parte degli ultimi 800.000 anni, il segnale isotopico antartico indica condizioni sensibilmente più fredde rispetto all’attuale fase interglaciale, mentre le transizioni verso i periodi caldi appaiono in genere rapide, seguite da un ritorno più lento verso condizioni glaciali. Questa asimmetria, già evidente nel record classico di Vostok e poi confermata da EPICA Dome C, costituisce una delle firme più robuste della dinamica glaciale-interglaciale del Pleistocene superiore. Tuttavia, la figura non suggerisce tanto una crescita lineare e continua dei “picchi caldi”, quanto piuttosto un cambiamento di regime attorno a 430.000 anni fa, in corrispondenza del cosiddetto Mid-Brunhes Event, dopo il quale gli interglaciali risultano mediamente più intensi e l’ampiezza delle oscillazioni climatiche aumenta rispetto alla parte più antica del record.

Dal punto di vista termico, i risultati di Jouzel e colleghi indicano che la variabilità della temperatura superficiale antartica, su medie secolari, raggiunge un’escursione di circa 15 °C negli ultimi 800.000 anni, dal minimo di circa −10,3 °C durante il MIS 2 al massimo di circa +4,5 °C durante il MIS 5.5, cioè l’ultimo interglaciale pieno, corrispondente all’Eemiano. Questo conferma che il precedente interglaciale fu, in Antartide orientale, più caldo dell’Olocene recente, mentre l’ultimo massimo glaciale rappresenta uno dei punti più freddi dell’intero archivio. Anche qui, però, è necessaria una precisazione metodologica importante: si tratta di una ricostruzione regionale antartica, non di una misura della temperatura media globale. Di conseguenza, il confronto con il riscaldamento moderno deve essere fatto con cautela, distinguendo sempre tra segnale polare locale e comportamento termico del pianeta nel suo complesso.

La serie della CO₂ segue in larga misura la stessa architettura climatica dei cicli glaciali-interglaciali. I dati compositi delle carote antartiche mostrano che, negli ultimi 800.000 anni, la concentrazione atmosferica di anidride carbonica è rimasta entro un intervallo naturale di circa 172–300 ppm, con minimi glaciali molto bassi e massimi interglaciali nettamente inferiori a quelli attuali. Le osservazioni moderne di Mauna Loa mostrano invece valori giornalieri attorno a 430 ppm nel marzo 2026, quindi ben oltre il corridoio di variabilità documentato dal record glaciale antartico. Per quanto riguarda i minimi glaciali, la fisiologia vegetale suggerisce prudenza verso affermazioni troppo drastiche: concentrazioni di 150–300 ppm riducono fortemente la fotosintesi delle piante C3, ma il dato sperimentale supporta soprattutto l’idea di una forte limitazione ecologica e produttiva, più che quella di un’immediata cessazione generalizzata della fotosintesi terrestre. Nel complesso, dunque, l’analisi dell’intero dataset mostra sì che l’attuale interglaciale si colloca dentro una lunga storia di oscillazioni naturali, ma evidenzia anche che i livelli moderni di CO₂ si collocano ormai al di fuori dell’intervallo naturale osservato nelle carote di ghiaccio antartiche del tardo Quaternario.

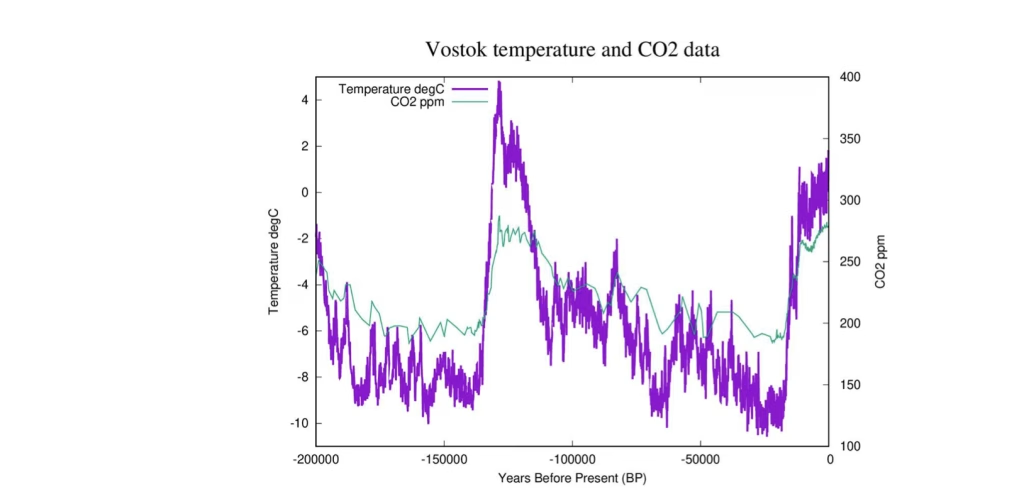

Figura 2. Lettura paleoclimatica degli ultimi 200.000 anni nel record di Vostok

La figura 2 rappresenta un ingrandimento del record isotopico e dei gas intrappolati nelle carote di ghiaccio antartiche, limitato agli ultimi 200.000 anni, cioè l’intervallo che comprende la parte finale del penultimo glaciale, la deglaciazione che conduce all’ultimo interglaciale, la lunga discesa verso l’ultima era glaciale e infine la transizione verso l’Olocene. La curva viola mostra la temperatura antartica ricostruita dal segnale isotopico dell’acqua, mentre la curva verde mostra la CO₂ atmosferica misurata nelle bolle d’aria del ghiaccio. Il primo elemento che emerge con chiarezza è la struttura fortemente asimmetrica del sistema climatico: i riscaldamenti verso le fasi interglaciali sono relativamente rapidi, mentre il ritorno alle condizioni glaciali è molto più graduale. Questa è una delle firme classiche dei cicli glaciali del tardo Quaternario documentate dal record di Vostok e poi confermate dai carotaggi EPICA Dome C, che mostrano una notevole coerenza tra i principali archivi isotopici dell’Antartide orientale.

Il picco più evidente della figura è quello dell’ultimo interglaciale, il MIS 5.5 o Eemiano, attorno a 125.000 anni fa, che nel record antartico risulta più caldo dell’interglaciale attuale. Jouzel e colleghi hanno stimato che, sui valori medi secolari, l’escursione della temperatura superficiale antartica negli ultimi 800.000 anni sia di circa 15 °C, con il minimo più freddo nel MIS 2 a circa −10,3 °C e il massimo più caldo nel MIS 5.5 a circa +4,5 °C nel record di Dome C; gli stessi autori sottolineano anche l’elevata somiglianza tra Dome C, Vostok e Dome F nella parte comune del record, il che permette di leggere la figura 2 come espressione della variabilità climatica dell’Antartide orientale su scala orbitale. In altri termini, la figura mostra molto bene che l’ultimo interglaciale non fu una semplice copia dell’Olocene, ma una fase climaticamente più calda in Antartide, seguita poi da una lunga e irregolare deriva verso il massimo glaciale dell’ultima glaciazione.

La seconda informazione fondamentale della figura è la forte covariazione fra temperatura e CO₂. Nel grafico la CO₂ oscilla grossomodo entro l’intervallo glaciale-interglaciale classico, intorno a 180–280 ppm, seguendo da vicino le grandi transizioni climatiche. Tuttavia, la letteratura mostra che questa relazione non va interpretata in modo semplicistico come una perfetta simultaneità punto per punto: durante alcune deglaciazioni il riscaldamento antartico locale può iniziare leggermente prima della crescita della CO₂, ma su scala globale l’aumento della CO₂ agisce poi come potente feedback e fattore amplificante del riscaldamento, contribuendo a propagare la transizione climatica ben oltre l’Antartide. Per questo la figura 2 è estremamente istruttiva: non dimostra soltanto che temperatura e CO₂ siano correlate, ma suggerisce anche che i grandi passaggi tra glaciali e interglaciali siano il risultato dell’interazione tra forcing orbitale, risposta dell’oceano meridionale, rilascio di carbonio all’atmosfera e feedback interni del sistema climatico. Letta correttamente, dunque, la figura non rappresenta la “temperatura media globale”, ma uno dei più solidi archivi regionali disponibili per capire come il sistema climatico terrestre abbia oscillato negli ultimi due cicli glaciali.

2.1 Quanto è insolito un aumento di 1,1 °C in un secolo?

La domanda posta in questa sottosezione è, sul piano statistico, legittima e persino utile, ma richiede una precisazione metodologica decisiva: ciò che si sta interrogando non è la rarità di un aumento della temperatura media globale in senso stretto, bensì la frequenza con cui un proxy termico antartico mostra incrementi di circa 1,1 °C tra due campioni consecutivi all’interno di un archivio glaciale molto lungo. Questo distingue nettamente il problema paleoclimatico da quello dell’attribuzione moderna. Il record EPICA-Dome C, in accordo con Vostok nella parte sovrapposta, documenta infatti la variabilità climatica antartica su circa 740.000–800.000 anni, ma la stessa ricostruzione termica di Jouzel e colleghi chiarisce che i dati sono espressi con media centennale fino a circa 140 ka BP, mentre per la parte più antica la risoluzione è più grossolana. Ne consegue che l’idea di valutare l’“insolito” di un aumento secolare lungo tutto il record deve fare i conti con una risoluzione che non è omogenea nel tempo: i “secoli” del tratto più recente non sono perfettamente equivalenti, sul piano informativo, ai campioni della parte più antica della serie.

Dal punto di vista analitico, la scelta di distinguere il dataset in regimi come interglacial rise, interglacial fall, ice agee other ha una sua logica climatologica, perché evita di trattare come stazionario un sistema che chiaramente non lo è. Mescolare in un’unica distribuzione i secoli appartenenti a rapide deglaciazioni, interglaciali relativamente stabili e lunghi periodi glaciali produce inevitabilmente una distribuzione composita, nella quale gli eventi estremi risultano “normalizzati” dalla commistione di dinamiche fisiche molto diverse. In questo senso, l’intuizione dell’autore è corretta: un incremento secolare di 1,1 °C può apparire relativamente frequente se lo si campiona durante le fasi di uscita da una glaciazione, ma molto meno comune se lo si esamina entro fasi interglaciali mature o dentro lunghi tratti glaciali. Tuttavia, la classificazione proposta nasce da una ispezione visiva della figura e quindi resta, almeno in parte, soggettiva; un approccio più robusto avrebbe potuto ancorare i regimi ai Marine Isotope Stages, oppure usare criteri algoritmici di change-point detection o soglie derivate direttamente dalla derivata temporale della serie.

C’è poi un secondo punto statistico spesso sottovalutato. In una carota di ghiaccio, i valori consecutivi non sono osservazioni indipendenti come in una sequenza di misure strumentali giornaliere o annuali. Il segnale isotopico è infatti il prodotto di processi di accumulo nevoso, compattazione del firn, diffusione isotopica, assottigliamento degli strati profondi e modellazione cronologica; per questo motivo la distribuzione delle differenze secolari riflette non solo la variabilità climatica, ma anche il modo in cui l’archivio conserva e smussa tale variabilità. In altre parole, la frequenza con cui compaiono salti di 1,1 °C nel record EPICA-Vostok è certamente informativa sulla dinamica naturale del clima antartico, ma non può essere letta come una probabilità universale del sistema climatico globale. La letteratura di sintesi su EPICA insiste proprio su questo aspetto: le carote antartiche sono archivi eccezionali per ricostruire intensità relative di glaciali e interglaciali, ma restano un osservatorio polare regionale, non una misura diretta della media globale.

Per questo motivo la domanda “quanto è insolito un aumento di 1,1 °C in un secolo?” cambia radicalmente significato a seconda del contesto scelto. Se il riferimento è un archivio antartico che include numerose deglaciazioni, allora non sorprende che esistano secoli con forti aumenti termici, soprattutto nelle fasi di transizione glaciale-interglaciale. Se invece il confronto corretto è con il riscaldamento globale moderno, allora il termine di paragone non dovrebbe essere un singolo proxy polare, ma una ricostruzione multiproxy distribuita spazialmente. Le ricostruzioni globali degli ultimi 24.000 anni mostrano che il clima terrestre risponde a forcing radiativi, calotte glaciali e gas serra con modalità diverse da quelle leggibili in un unico archivio locale, mentre l’IPCC conclude che l’influenza umana ha riscaldato in modo inequivocabile atmosfera, oceano e terre emerse, portando la temperatura superficiale globale a circa 1,1 °C sopra il livello 1850–1900 nel 2011–2020. Questo significa che la presenza di forti aumenti secolari in un record antartico non rende superflua l’attribuzione, ma semmai impone di formulare meglio la domanda: non se il clima della Terra abbia mai mostrato rapidi aumenti naturali in qualche regione o durante transizioni deglaciali, bensì se l’attuale riscaldamento globale, simultaneo e fisicamente forzato dai gas serra antropogenici sia comparabile, per scala e causa, a quei precedenti. La letteratura attuale risponde sostanzialmente di no.

In definitiva, questa sottosezione tocca un problema reale e interessante: la necessità di distinguere tra rarità statistica interna a un archivio paleoclimatico e eccezionalità climatica del riscaldamento moderno. La prima può essere esplorata calcolando la distribuzione delle differenze secolari all’interno di regimi climatici differenti; la seconda richiede invece confronti tra grandezze omogenee, cioè tra temperature globali ricostruite globalmente e non tra media globale moderna e temperatura antartica proxy. È proprio qui che il valore del ragionamento statistico incontra il suo limite epistemologico: l’archivio EPICA-Vostok è ideale per studiare la variabilità naturale del clima antartico su lunghissime scale temporali, ma non basta da solo per concludere se l’attuale aumento globale di 1,1 °C sia o non sia “insolito” nel senso climaticamente più rilevante del termine.

Gli ultimi 20.000 anni e il significato paleoclimatico della deglaciazione

Gli ultimi 20.000 anni corrispondono alla fase terminale della transizione dall’Ultimo Massimo Glaciale all’interglaciale olocenico e costituiscono uno dei laboratori naturali più importanti per comprendere la risposta del sistema climatico a grandi perturbazioni esterne. In questo quadro, però, è essenziale non confondere il segnale regionale antartico con la temperatura media globale. Il record isotopico di EPICA Dome C documenta infatti una variabilità locale dell’Antartide orientale di grande ampiezza, con un range termico di circa 15 °C calcolato su valori mediati a 100 anni, e per questo motivo le differenze osservate nel ghiaccio antartico descrivono soprattutto l’intensità della risposta polare australe, non la variazione media dell’intero pianeta. Le ricostruzioni globali basate su assimilazione di proxy e modelli indicano invece che il riscaldamento tra l’avvio della deglaciazione e il periodo preindustriale fu dell’ordine di 7,1 ± 0,9 °C, mentre il raffreddamento globale del Last Glacial Maximum rispetto al preindustriale è stimato intorno a 6,1 °C; ciò mostra con chiarezza che una variazione di circa 12 °C ricavata da un archivio antartico non può essere assunta come equivalente della temperatura media globale, pur restando fisicamente coerente con una forte amplificazione polare.

Ne consegue che la semplice media di circa 0,06 °C per secolo, ottenuta dividendo il riscaldamento complessivo per l’intero intervallo deglaciale, ha un valore soltanto descrittivo e rischia di essere climaticamente fuorviante. La deglaciazione non fu un processo lineare, ma una successione di fasi caratterizzate da accelerazioni, rallentamenti e brusche riorganizzazioni del sistema oceano-atmosfera. Le sintesi paleoclimatiche mostrano che gran parte della variabilità deglaciale può essere interpretata come sovrapposizione di due grandi modalità: una legata al forcing radiativo di gas serra e calotte glaciali, l’altra associata ai cambiamenti della circolazione meridionale atlantica e, più in generale, alla dinamica del trasporto di calore oceanico. In questa prospettiva, eventi come il Bølling-Allerød non rappresentano “rumore statistico” entro una distribuzione stazionaria, ma la risposta del clima a soglie dinamiche e a rapide riorganizzazioni della circolazione, come mostrato sia dalle simulazioni transitorie sia dai record ad alta risoluzione di CO2 e CH4 della deglaciazione. Anche il contenuto termico oceanico conferma il carattere strutturato della transizione: il riscaldamento dell’oceano globale tra 20 e 10 ka fu di circa 2,57 ± 0,24 °C, segnalando che il passaggio al clima olocenico coinvolse l’intero sistema Terra e non soltanto l’atmosfera superficiale.

Alla luce di tutto questo, il confronto diretto fra un incremento di 1,1 °C in un secolo e le variazioni secolari ricavate da un proxy antartico locale va trattato con estrema cautela. L’IPCC indica che la temperatura superficiale globale nel 2011–2020 è stata di 1,09 °C superiore al periodo 1850–1900 e che il riscaldamento globale recente è stato inequivocabilmente causato dalle attività umane; siamo quindi di fronte a un segnale globale, simultaneo e forzato antropicamente, non a una semplice oscillazione regionale interna. Inoltre, le ricostruzioni oloceniche mostrano che il più caldo intervallo di 200 anni degli ultimi 12.000 anni, centrato attorno a 6,5 ka, fu mediamente circa 0,7 °C più caldo del XIX secolo, ma per l’80% dei membri dell’ensemble nessun intervallo bicentenario dell’Olocene supera il calore del decennio più recente. Anche sul piano metodologico serve prudenza: nei test di normalità un p-value non significativo non dimostra che i dati siano gaussiani, ma solo che il campione non fornisce evidenza sufficiente per rigettare quell’ipotesi; quando poi si lavora con serie temporali autocorrelate, come hanno mostrato Bai e Ng, la distribuzione dei test di skewness, kurtosis e normalità dipende dalla struttura di dipendenza seriale e non può essere trattata come se le osservazioni fossero indipendenti. Per questo motivo il valore scientifico del record EPICA-Vostok è enorme per ricostruire la dinamica naturale del clima pleistocenico, ma non autorizza, da solo, a ridimensionare il significato del riscaldamento contemporaneo: le migliori ricostruzioni globali concludono infatti che sia il tasso sia la magnitudine del riscaldamento moderno risultano insoliti nel contesto degli ultimi 24.000 anni.

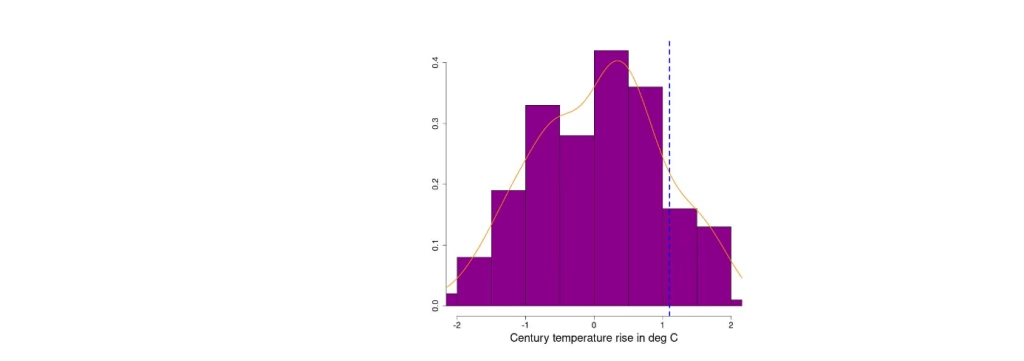

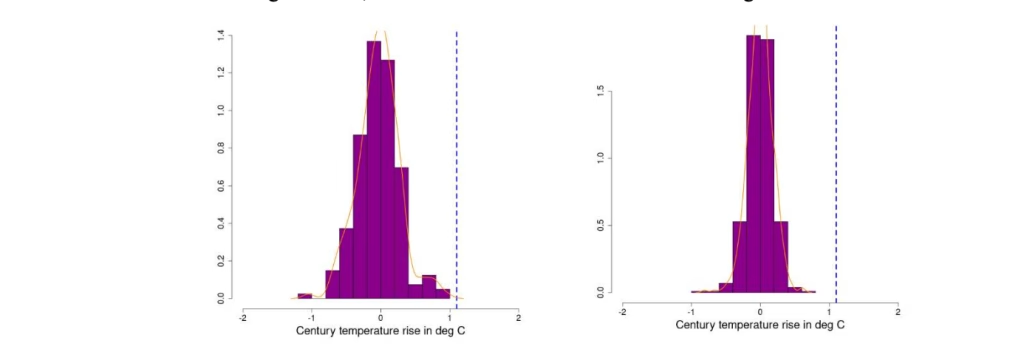

Figura 3. Distribuzione delle variazioni secolari di temperatura negli ultimi 20.000 anni

La figura 3 trasforma gli ultimi 20.000 anni del record glaciale antartico in una distribuzione delle differenze di temperatura da un secolo al successivo, cioè in un istogramma che non descrive più l’evoluzione cronologica del clima, ma la frequenza statistica delle sue oscillazioni secolari. In questo senso il grafico è molto utile, perché mostra che la deglaciazione e l’interglaciale olocenico non sono stati processi lineari: accanto a molti secoli con variazioni modeste, compaiono anche incrementi e diminuzioni più marcati, segno che la transizione dall’ultimo massimo glaciale all’Olocene fu modulata da più meccanismi fisici. Le ricostruzioni globali degli ultimi 24.000 anni indicano infatti che la variabilità climatica in questo intervallo fu controllata soprattutto da due grandi fattori: da un lato il forcing radiativo associato a calotte glaciali e gas serra, dall’altro la sovrapposizione di cambiamenti nella circolazione oceanica e nell’insolazione stagionale; allo stesso tempo, i record di Dome C e Vostok mostrano che il clima del tardo Quaternario è dominato da grandi oscillazioni glaciali-interglaciali, nelle quali il segnale antartico registra in modo molto netto fasi di rapido riscaldamento e di successiva variabilità più irregolare.

Dal punto di vista visivo, l’istogramma appare approssimativamente “a campana”, con una concentrazione maggiore di valori attorno a piccole variazioni positive o prossime allo zero, mentre la linea blu tratteggiata a +1,1 °C per secolo si colloca nella coda destra della distribuzione. Questo significa che, nel contesto del solo proxy antartico e del solo intervallo postglaciale, un incremento di tale entità non è fuori scala assoluta, ma resta comunque un evento collocato nella parte meno frequente delle variazioni osservate. Tuttavia, la lettura climatologica della figura richiede cautela: il grafico non confronta una temperatura media globale strumentale con una sua serie omogenea nel passato, bensì un proxy regionale antartico con forti caratteristiche locali. Per questo motivo la presenza, nel record, di alcuni aumenti secolari elevati non implica automaticamente che l’attuale riscaldamento globale sia “normale”. Al contrario, le ricostruzioni globali di Osman e colleghi mostrano che sia il tasso sia la magnitudine del riscaldamento moderno risultano inusuali rispetto agli ultimi 24.000 anni, mentre l’IPCC conclude che la temperatura superficiale globale ha raggiunto circa 1,1 °C sopra il livello 1850–1900 nel 2011–2020 per effetto inequivocabile delle attività umane.

Anche sul piano statistico la figura va interpretata con misura. Il fatto che l’istogramma sembri vicino a una distribuzione normale rende comprensibile l’uso di un test come lo Shapiro–Wilk, che in letteratura è considerato uno dei controlli più efficaci per la normalità campionaria; tuttavia gli stessi testi metodologici ricordano che i test di normalità devono essere usati come supporto alla valutazione grafica e che il loro esito dipende dalla numerosità del campione e dalla struttura dei dati. Nel caso delle serie temporali, inoltre, la questione è ancora più delicata, perché esistono test specifici sviluppati proprio per dati correlati serialmente, segno che trattare una sequenza paleoclimatica come un insieme di osservazioni del tutto indipendenti può essere riduttivo. Di conseguenza, la figura 3 è molto preziosa come sintesi descrittiva della variabilità naturale secolare durante la deglaciazione e l’Olocene, ma non può essere assunta da sola come prova conclusiva contro l’eccezionalità del riscaldamento globale moderno.

Estensione dell’analisi all’ultimo interglaciale

L’estensione dell’analisi agli ultimi 150.000 anni ha un indubbio valore paleoclimatico perché include, in un’unica finestra, il culmine e il declino dell’ultimo interglaciale, la lunga transizione verso lo stato glaciale e infine il ritorno alle condizioni oloceniche. In termini stratigrafici, questa sequenza abbraccia il Last Interglacial o MIS 5e, comunemente collocato tra circa 129 e 116 ka, e consente quindi di confrontare due condizioni calde separate da una glaciazione completa. Proprio per questo il record EPICA Dome C è particolarmente utile: la sintesi sul carotaggio mostra che, all’interno degli ultimi 800.000 anni, MIS 5.5 e MIS 11 figurano tra i massimi interglaciali più caldi, mentre MIS 2 rientra fra i massimi glaciali più intensi; inoltre, per i quattro cicli glaciali più recenti il comportamento di Dome C concorda bene con quello di Vostok, e la sincronizzazione specifica fra i due archivi nell’intervallo 0–145 ka è stata ulteriormente raffinata tramite marcatori vulcanici comuni, rafforzando la robustezza del confronto tra ultimo interglaciale, ultima glaciazione e deglaciazione finale. In questo senso, la tabella discussa nel paper ha un pregio reale: mostra che la frequenza degli incrementi secolari dipende dal regime climatico di fondo e che il sistema non esprime una “variabilità naturale” unica e invariabile, ma distribuzioni differenti a seconda che si osservi una fase interglaciale calda, una discesa glaciale o una risalita deglaciale.

Dal punto di vista interpretativo, però, il significato della tabella va delimitato con precisione. Se un test di Shapiro–Wilk restituisce p > 0,05, il risultato indica soltanto che i dati non forniscono evidenza sufficiente per rigettare l’ipotesi di normalità; non dimostra che la distribuzione sia davvero gaussiana, né che tale approssimazione sia automaticamente adeguata a fondare inferenze forti. Questa cautela è ancora più importante quando si lavora con serie paleoclimatiche, perché le differenze secolari ricavate da una carota di ghiaccio non sono osservazioni indipendenti: incorporano persistenza climatica, smoothing fisico del segnale e dipendenza seriale. La letteratura metodologica sui test di normalità per dati correlati sottolinea infatti che la presenza di autocorrelazione modifica la distribuzione delle statistiche di skewness e kurtosis e richiede procedure formulate esplicitamente per osservazioni dipendenti. Perciò la probabilità P(T > 1,1) ricavata nel paper può essere letta come esercizio descrittivo utile a confrontare regimi climatici diversi all’interno del proxy antartico, ma non come prova robusta del fatto che un riscaldamento globale moderno di pari ampiezza sia “normale” in senso fisico generale. Il punto chiave, insomma, è che la rarità statistica interna a una singola serie regionale e l’eccezionalità climatica di un segnale globale sono due problemi distinti, che non possono essere fusi senza perdere rigore metodologico.

È qui che il confronto con le ricostruzioni globali diventa decisivo. Le analisi paleoclimatiche basate su assimilazione di dati mostrano che la temperatura media globale è aumentata di circa 7 °C dall’avvio della deglaciazione al preindustriale e che la variabilità degli ultimi 24.000 anni riflette soprattutto due grandi controlli: il forcing radiativo associato a gas serra e calotte glaciali, e la sovrapposizione di cambiamenti nella circolazione oceanica e nell’insolazione stagionale. Nello stesso tempo, queste ricostruzioni mostrano che i tassi di riscaldamento osservati dopo il 1910 superano il 99° percentile dei tassi centenari ricavati dalla deglaciazione, mentre le sintesi dell’Olocene indicano che il più caldo intervallo bicentenario preindustriale, attorno a 6,5 ka, fu sì più caldo del XIX secolo, ma non fornisce un’analogia semplice con il carattere rapido, globale e antropogenico del riscaldamento contemporaneo. Di conseguenza, l’estensione all’ultimo interglaciale arricchisce l’analisi perché mostra bene quanto conti lo stato di fondo del sistema climatico nel modulare la distribuzione delle variazioni termiche; tuttavia non indebolisce l’attribuzione del riscaldamento moderno, ma piuttosto chiarisce che per valutarne la singolarità servono confronti omogenei con la temperatura media globale, non soltanto con un archivio isotopico antartico, per quanto straordinario esso sia.

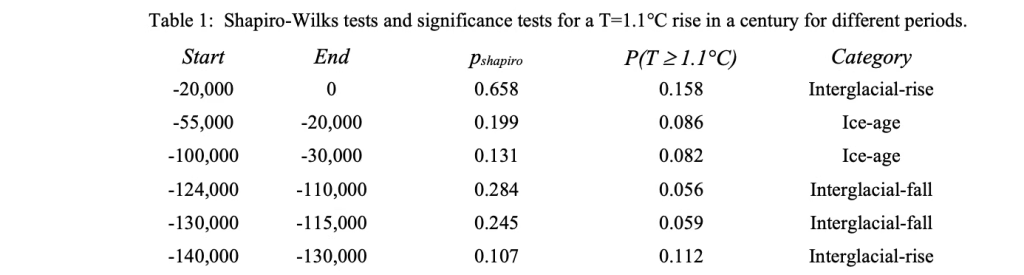

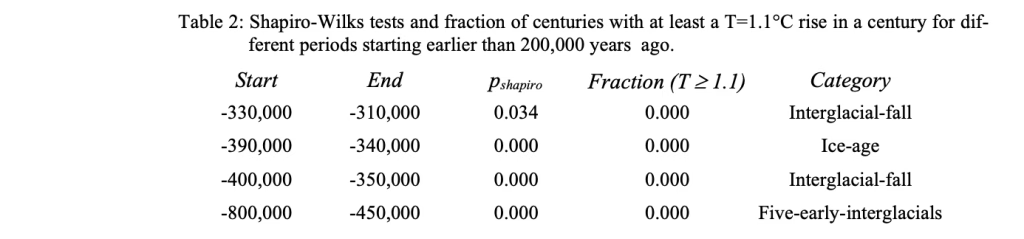

Tabella 1. Interpretazione statistica e paleoclimatica degli aumenti secolari di temperatura

La tabella 1 confronta sei intervalli degli ultimi 150.000 anni e serve a verificare due aspetti: se le variazioni di temperatura da un secolo al successivo possano essere trattate, in prima approssimazione, come distribuzioni quasi normali, e quanto sia probabile osservare in ciascun intervallo un aumento di almeno 1,1 °C in un secolo. Il contesto paleoclimatico è quello ricostruito dalle carote di ghiaccio antartiche di Vostok ed EPICA Dome C, che concordano bene nella parte sovrapposta del record; EPICA ha inoltre esteso l’archivio climatico antartico fino a circa 740.000 anni, poi portati a circa 800.000 anni nelle serie successive, rendendo possibile un confronto tra fasi di risalita interglaciale, decadimento interglaciale e pieno glaciale.

Dal punto di vista statistico, la colonna p_shapiro riporta il p-value del test di Shapiro–Wilk. Poiché tutti i valori della tabella sono superiori a 0,05 — 0,658, 0,199, 0,131, 0,284, 0,245 e 0,107 — l’autore considera ragionevole approssimare queste distribuzioni con una normale. Questa lettura è metodologicamente comprensibile, ma va interpretata con cautela, perché il mancato rigetto della normalità non dimostra che i dati siano davvero gaussiani, e nelle serie temporali climatiche l’autocorrelazione seriale può complicare l’uso dei test standard di normalità.

La colonna più importante è P(T ≥ 1,1 °C), che stima la probabilità di un aumento secolare almeno pari a 1,1 °C nei diversi regimi climatici. Negli ultimi 20.000 anni (−20.000 / 0), classificati come Interglacial-rise, il valore è 0,158, cioè il più alto della tabella: questo è coerente con il fatto che tale intervallo comprende la deglaciazione e l’ingresso nell’interglaciale attuale, una fase naturalmente favorevole a riscaldamenti rapidi. Nei due tratti classificati come Ice-age, −55.000 / −20.000 e −100.000 / −30.000, i valori scendono a 0,086 e 0,082, segnalando che durante le lunghe condizioni glaciali i forti aumenti secolari sono meno probabili, pur restando possibili. Nelle due fasi di Interglacial-fall, −124.000 / −110.000 e −130.000 / −115.000, le probabilità sono 0,056 e 0,059, le più basse dell’intera tabella, cosa fisicamente plausibile perché si tratta del declino successivo al massimo dell’ultimo interglaciale. Infine, nel tratto −140.000 / −130.000, ancora Interglacial-rise, la probabilità torna a 0,112, confermando che le fasi di transizione verso condizioni più miti favoriscono aumenti secolari più vigorosi. Nel complesso, la tabella mostra bene che la frequenza degli aumenti di 1,1 °C dipende fortemente dal regime climatico di fondo e non è uniforme lungo il record.

Il punto scientificamente più importante, però, è un altro: questa tabella descrive la variabilità di un proxy termico antartico regionale, non della temperatura media globale. Perciò è utile per capire quanto siano frequenti certi salti termici all’interno del record EPICA-Vostok, ma non basta da sola a stabilire se il riscaldamento globale moderno sia oppure no eccezionale nel senso climatico più ampio. Le ricostruzioni globali degli ultimi 24.000 anni mostrano infatti che il riscaldamento recente, considerato come fenomeno planetario, ha una rapidità e una coerenza spaziale molto particolari rispetto al quadro tardo-quaternario. In questo senso, la tabella 1 è molto efficace come analisi della variabilità interna del paleoclima antartico, ma non può essere assunta come prova conclusiva contro l’eccezionalità del riscaldamento globale contemporaneo.

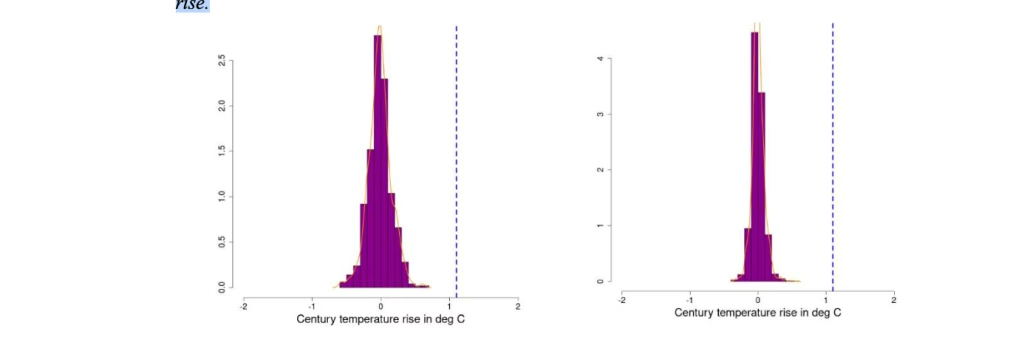

Estensione dell’analisi a periodi anteriori a 200.000 anni

Quando l’analisi viene estesa a intervalli anteriori a 200.000 anni fa, il quadro paleoclimatico cambia in modo significativo e il risultato descritto nel paragrafo acquista un interesse particolare. Il record isotopico di EPICA Dome C, che copre circa 800.000 anni di storia climatica antartica, mostra infatti che la variabilità non è omogenea lungo tutto l’archivio: nelle porzioni più antiche emergono differenze sia nell’intensità dei massimi interglaciali sia nell’ampiezza delle oscillazioni termiche, e già il lavoro classico di EPICA aveva evidenziato che, nella fascia compresa grossomodo tra 740 e 430 ka, gli interglaciali antartici risultavano mediamente meno caldi dei più recenti, pur occupando una frazione maggiore del ciclo in condizioni relativamente miti. In questa prospettiva, il fatto che nella Tabella 2 la dispersione delle variazioni secolari si riduca progressivamente andando indietro nel tempo è coerente con l’idea che il clima antartico del Pleistocene medio-superiore non presenti un’unica struttura statistica invariabile, ma regimi diversi, con ampiezze differenti della risposta isotopica e con una predominanza crescente dei segnali a scala orbitale rispetto agli sbalzi più marcati osservabili nelle grandi transizioni deglaciali più recenti. Anche le analisi ad alta risoluzione del dataset EPICA confermano che la variabilità più intensa tende a concentrarsi soprattutto nelle fasi di ingresso nei periodi caldi, mentre al di fuori di queste transizioni la dinamica appare più contenuta; da questo punto di vista, il fatto che prima di 200 ka non compaiano aumenti secolari di 1,1 °C nel proxy antartico non sorprende, ma riflette un archivio in cui i salti rapidi di grande ampiezza diventano molto meno frequenti.

Dal punto di vista metodologico, però, il passaggio più importante del paragrafo è un altro: riconoscere che in questa parte del record i residui non sono più compatibili con una distribuzione normale e che, di conseguenza, l’inferenza deve limitarsi a una semplice frequenza empirica degli eventi. Questa è una scelta statisticamente sensata, perché la letteratura sui test di normalità per serie temporali mostra che skewness, kurtosis e test congiunti di normalità cambiano comportamento quando i dati sono serialmente dipendenti, e dunque non possono essere interpretati come se le osservazioni fossero indipendenti. In più, nel caso delle carote di ghiaccio profonde, la prudenza è ancora più necessaria perché la parte inferiore del record può risentire di effetti glaciologici che alterano la leggibilità del segnale ad alta frequenza: per EPICA Dome C è stato mostrato che, pur restando riconoscibile il segnale paleoclimatico generale, nella sezione più profonda la scala temporale subisce distorsioni dovute allo stiramento meccanico del ghiaccio e compaiono fenomeni di smoothing isotopico che rendono più delicata la lettura delle variazioni più rapide. Ne segue che il risultato della Tabella 2 è interessante e, nel suo contesto, plausibile: prima di 200.000 anni fa un aumento di 1,1 °C per secolo nel proxy termico antartico appare altamente inusuale. Tuttavia, questo non equivale automaticamente a un confronto diretto con il riscaldamento moderno globale, perché quest’ultimo riguarda la temperatura media planetaria e, secondo le ricostruzioni assimilative più recenti, presenta tassi che eccedono quelli tipici della variabilità naturale osservata negli ultimi 24.000 anni. Il valore scientifico del paragrafo, quindi, non sta tanto nel fornire un argomento definitivo sul presente, quanto nel mostrare che la probabilità dei grandi incrementi termici dipende fortemente dal regime climatico, dalla porzione dell’archivio considerata e dai limiti statistici e fisici del proxy utilizzato.

Estensione dell’analisi ai periodi anteriori a 200.000 anni: interpretazione scientifica della Tabella 2

La Tabella 2 mostra che, quando l’analisi viene spinta a segmenti del record antartico più antichi di 200.000 anni, il comportamento statistico delle variazioni termiche secolari cambia in modo netto. I quattro intervalli considerati sono compresi tra 330–310 ka, 390–340 ka, 400–350 ka e 800–450 ka, e in tutti i casi la colonna Fraction (T ≥ 1.1) assume valore 0.000, cioè non compare neppure un singolo secolo con un aumento di temperatura pari o superiore a 1,1 °C. Parallelamente, i valori del test di Shapiro–Wilk sono 0,034, 0,000, 0,000 e 0,000: adottando la soglia convenzionale di 0,05, ciò implica che in tutti e quattro i campioni l’ipotesi di normalità viene respinta, anche se il caso 330–310 karisulta meno distante dalla soglia rispetto agli altri. Questo passaggio è importante, perché indica che per questi periodi non è più appropriato ragionare con una distribuzione gaussiana dei residui, ma occorre limitarsi a una lettura empirica delle frequenze osservate. In altre parole, la tabella non dice soltanto che gli aumenti di 1,1 °C per secolo sono assenti, ma anche che la struttura statistica delle variazioni secolari diventa più irregolare e meno compatibile con i modelli semplici adottati per i periodi più recenti.

Sul piano paleoclimatico, questo risultato è coerente con ciò che emerge dal grande archivio di EPICA Dome C, che estende il record climatico antartico fino a circa 800.000 anni e documenta una storia non uniforme della variabilità glaciale-interglaciale. Il lavoro di Jouzel e colleghi mostra che il range della temperatura superficiale antartica ricavata dal deuterio è di circa 15 °C sull’intero archivio, dal minimo glaciale di MIS 2 al massimo di MIS 5.5, ma evidenzia anche che gli interglaciali più antichi, inclusi quelli precedenti a circa 430 ka, furono generalmente meno caldi dei grandi interglaciali più recenti, mentre i glaciali anteriori a 430 ka risultarono in media meno rigidi di MIS 2. In particolare, gli autori confermano che gli “early interglacials”, fino a includere MIS 19, furono caratterizzati da un calore meno pronunciato rispetto agli ultimi quattro grandi cicli climatici, un aspetto coerente con il noto cambiamento di ampiezza climatica associato al Mid-Brunhes Event attorno a 430 ka. Letta in questo quadro, la Tabella 2 suggerisce che la parte più antica del record sia dominata da una variabilità secolare più contenuta, con distribuzioni meno espansive e senza episodi estremi paragonabili ai rapidi incrementi osservabili nei tratti più dinamici della deglaciazione recente. La stessa presentazione del record EPICA invita inoltre alla prudenza, perché gli autori riportano medie centennali fino a 140 ka, mentre per i periodi più antichi mostrano il dettaglio ricavato dai dati grezzi a 0,55 mcon una curva smussata a 700 anni sovrapposta, segnalando implicitamente che l’interpretazione degli estremi a scala secolare diventa più delicata scendendo nella parte profonda della carota.

Ne deriva che i dati della Tabella 2 hanno un significato robusto all’interno del proxy antartico: nelle categorie Interglacial-fall, Ice-age e Five-early-interglacials gli aumenti di 1,1 °C in un secolo risultano assenti, e questo rafforza l’idea che andando oltre i 200 ka la dispersione delle variazioni secolari si restringa sensibilmente. Tuttavia, il valore interpretativo della tabella resta confinato al contesto di un archivio regionale dell’Antartide orientale. Essa descrive la dinamica interna del record EPICA e il modo in cui cambia la distribuzione delle variazioni termiche attraverso diversi regimi climatici del Pleistocene, ma non può essere trasferita automaticamente alla temperatura media globale. Le ricostruzioni paleoclimatiche globali più recenti mostrano infatti che, su scala planetaria, sia il tasso sia la magnitudine del riscaldamento moderno risultano insoliti rispetto agli ultimi 24.000 anni; perciò la lezione più solida della Tabella 2 non è che il presente sia “normale”, ma che la probabilità degli estremi termici dipende in modo decisivo dallo stato di fondo del sistema climatico, dalla parte dell’archivio considerata e dal tipo di indicatore utilizzato.

Interpretazione paleoclimatica della Figura 4

La Figura 4 mostra in modo molto efficace come si distribuiscano le variazioni della temperatura antartica su scala secolare in due intervalli anteriori a 200.000 anni fa, cioè 330.000–310.000 anni fa nel pannello di sinistra e 390.000–340.000 anni fa in quello di destra. In entrambi i casi l’istogramma è fortemente concentrato attorno a variazioni piccole, prossime allo zero, e la linea blu tratteggiata che rappresenta un aumento di +1,1 °C in un secolo si colloca nettamente alla destra della massa principale della distribuzione. Il messaggio visivo è quindi molto chiaro: nei due intervalli considerati i cambiamenti secolari positivi esistono, ma restano modesti rispetto alla soglia di 1,1 °C, che non viene raggiunta. Inoltre, il confronto fra i due pannelli suggerisce che il periodo 390–340 ka presenti una distribuzione ancora più stretta e compressa rispetto al 330–310 ka, cioè una dispersione minore delle variazioni secolari. Questa lettura è coerente con l’uso del record di EPICA Dome C, il più lungo archivio continuo isotopico antartico oggi disponibile, che copre circa 800.000 anni e documenta un’escursione complessiva della temperatura superficiale antartica di circa 15 °C tra i minimi glaciali e i massimi interglaciali; lo stesso lavoro di Jouzel e colleghi chiarisce inoltre che fino a circa 140 ka il record è presentato con medie centennali, mentre per gli intervalli più antichi la serie deriva da dati grezzi a 0,55 m con una curva smussata a 700 anni sovrapposta, un dettaglio importante perché ricorda che la leggibilità della variabilità ad alta frequenza non è uniforme lungo tutta la carota.

Dal punto di vista climatico, la figura suggerisce quindi che nei segmenti più antichi del record antartico la variabilità centenaria fosse più contenuta rispetto a quella osservabile nelle grandi fasi di transizione, come la deglaciazione più recente o alcuni tratti dell’ultimo interglaciale. Questo punto trova un riscontro nella letteratura più recente ad alta risoluzione su Dome C: la compilazione isotopica di Grisart et al. (2022) mostra che il record EDC, grazie ai campionamenti a 11 cm, permette di indagare la variabilità da scala decadale a millenaria, ma evidenzia anche che l’intensità della variabilità multidecadale e multicentenaria non è costante nel tempo e che i processi di diffusione isotopica possono attenuare parte del segnale ad alta frequenza, soprattutto negli strati più antichi o termicamente più rimaneggiati. In altri termini, la forma stretta degli istogrammi della Figura 4 può essere letta in due modi complementari: da un lato come segnale di una reale minore ampiezza delle oscillazioni secolari in quei regimi climatici; dall’altro come indicazione del fatto che il proxy, scendendo verso porzioni più profonde della carota, tende a preservare meno bene la componente più rapida della variabilità. La letteratura su MIS 19 in EPICA Dome C va proprio in questa direzione, mostrando che anche con un campionamento più fine il segnale più antico resta relativamente smussato e che una parte della variabilità sub-millenaria può essere stata fisicamente erasa dalla diffusione.

Sul piano statistico, la Figura 4 è importante anche perché conferma visivamente ciò che la Tabella 2 suggerisce numericamente: qui non siamo più in presenza di distribuzioni ben descritte da una gaussiana semplice, e infatti l’autore rinuncia a un’inferenza parametrica forte e si limita alla frequenza osservata degli eventi. Questa cautela è metodologicamente fondata, perché i test di normalità applicati a serie temporali correlate sono problematici: Lobato e Velasco mostrano che, quando i dati presentano dipendenza seriale, le versioni standard dei test basati su skewness e kurtosis diventano invalide se trattate come se le osservazioni fossero indipendenti. Di conseguenza, la lezione più robusta della Figura 4 non è tanto che “il clima antico non cambiava rapidamente”, quanto piuttosto che, nei due intervalli considerati, il proxy termico antartico non registra secoli con aumenti pari a +1,1 °C, e che tali variazioni si collocano fuori dal comportamento empiricamente osservato in quelle finestre temporali. Questo, però, resta un risultato riferito a un archivio regionale antartico; non equivale automaticamente a un confronto diretto con la temperatura media globale, che nelle ricostruzioni assimilative più recenti mostra invece che il riscaldamento moderno, per tasso e magnitudine, è anomalo rispetto alla variabilità degli ultimi 24.000 anni.

Interpretazione paleoclimatica della Figura 5

La Figura 5 mette in evidenza, con notevole chiarezza, che nei due intervalli più antichi analizzati del record di Dome C — 400.000–350.000 anni fa nel pannello sinistro e 800.000–450.000 anni fa nel pannello destro — la distribuzione delle variazioni termiche su scala secolare risulta fortemente concentrata attorno a valori piccoli, prossimi allo zero, mentre la soglia di +1,1 °C in un secolo, indicata dalla linea blu tratteggiata, si colloca nettamente al di fuori della nube principale dei dati. Il significato immediato della figura è dunque che, in questi segmenti del proxy antartico, i cambiamenti secolari positivi esistono ma restano modesti, e non raggiungono l’ampiezza della soglia scelta come termine di confronto. Questo comportamento è coerente con le caratteristiche generali del record EPICA Dome C, che estende la ricostruzione isotopica antartica fino a circa 800.000 anni e documenta la successione di otto cicli glaciali–interglaciali, mostrando però che l’intensità dei periodi caldi e la struttura della variabilità non sono uniformi lungo tutto l’archivio. In particolare, i lavori di Jouzel e colleghi e le sintesi successive indicano che gli interglaciali successivi a circa 430 ka furono mediamente più caldi e di maggiore ampiezza rispetto a molti di quelli precedenti, nel contesto della cosiddetta Mid-Brunhes Transition, cioè il passaggio verso oscillazioni glaciali–interglaciali di maggiore intensità nel tardo Pleistocene.

Dal punto di vista strettamente visivo, il confronto tra i due pannelli è molto istruttivo. L’istogramma relativo a 400–350 ka è già piuttosto stretto, ma quello compreso tra 800 e 450 ka appare ancora più compresso, con una dispersione minore e una concentrazione ancora più marcata attorno a variazioni centenarie deboli. Paleoclimaticamente, questo suggerisce che nella parte più antica del record la variabilità ad alta frequenza fosse meno evidente, o comunque meno ampia nel segnale preservato, rispetto a quanto osservabile in tratti più recenti e dinamici come le grandi deglaciazioni o i massimi interglaciali più intensi. La letteratura più recente ad alta risoluzione sull’archivio EDC conferma che il carotaggio offre un’opportunità unica per studiare la variabilità da scala decadale a millenaria lungo gli ultimi 800 ka, ma mostra anche che la leggibilità della componente più rapida non è costante con la profondità: i segnali ad alta frequenza possono essere attenuati da processi di diffusione isotopica e, nella parte più antica del nucleo, la conservazione della piena variabilità sub-millenaria può risultare problematica. In questo senso, la Figura 5 non va letta soltanto come prova di una minore dinamica climatica, ma più precisamente come evidenza che il proxy isotopico antartico preservato in questi intervalli mostra una gamma molto ristretta di variazioni secolari, senza episodi estremi comparabili alla soglia di +1,1 °C.

Il valore scientifico della figura sta quindi nel mostrare che, procedendo verso i segmenti più antichi del Pleistocene superiore e medio, la distribuzione dei cambiamenti termici secolari tende a restringersi e a perdere quelle code positive più ampie che potevano comparire nei periodi più recenti. Questo risultato si inserisce bene nel quadro fornito dalla cronologia EDC3 e dalle successive revisioni del record, secondo cui il nucleo di Dome C resta straordinariamente affidabile per ricostruire l’andamento climatico a scala orbitale fino a 800 ka, ma con incertezze crescenti quando si vogliono interpretare durata e ampiezza degli eventi più rapidi nelle parti profonde del ghiaccio. La Figura 5, perciò, rafforza una conclusione importante: nei periodi 400–350 ka e soprattutto 800–450 ka, un aumento di 1,1 °C in un secolo non appartiene al comportamento empiricamente osservato del record antartico mostrato, e appare quindi altamente inusuale all’interno di questi specifici regimi climatici. Al tempo stesso, la figura ricorda che questo tipo di inferenza riguarda un archivio regionale dell’Antartide orientale e non può essere trasferito in modo automatico alla temperatura media globale, la cui valutazione richiede ricostruzioni spazialmente distribuite e confronti omogenei su scala planetaria.

Valore paleoclimatico e limiti interpretativi delle conclusioni tratte dal record di Vostok

Le conclusioni proposte a partire dal record di Vostok hanno il merito di richiamare l’enorme valore dei carotaggi antartici per lo studio della variabilità climatica quaternaria, ma risultano troppo forti rispetto a ciò che il proxy consente realmente di inferire. I grandi archivi isotopici di Vostok ed EPICA Dome C descrivono in primo luogo la risposta termica dell’Antartide interna, non la temperatura media globale, e questa distinzione è decisiva. Il record di Dome C mostra effettivamente una grande ampiezza glaciale-interglaciale lungo gli ultimi 800.000 anni, ma la stessa pubblicazione di Jouzel e colleghi segnala che i dati sono riportati come medie centennali solo fino a circa 140 ka, mentre per intervalli più antichi si lavora su dati grezzi con una curva smussata a 700 anni sovrapposta. Inoltre, studi recenti sulla fisica degli isotopi nel ghiaccio profondo mostrano che diffusione isotopica, assottigliamento degli strati e deformazione del ghiaccio attenuano progressivamente la variabilità ad alta frequenza, fino a poter smorzare componenti anche sub-millenarie o millenarie nelle parti più antiche del nucleo. Perciò l’idea che “negli ultimi 200.000 anni la temperatura sia diventata più volatile” non può essere assunta come fatto fisico dimostrato dal solo istogramma delle differenze secolari: può riflettere sia una reale riorganizzazione della dinamica climatica, sia la diversa capacità dell’archivio di preservare la variabilità rapida con la profondità. A questo si aggiunge che la letteratura sul Mid-Brunhes Event, attorno a 430 ka, documenta davvero un aumento dell’ampiezza dei cicli climatici e interglaciali mediamente più caldi dopo quella soglia, quindi una parte del cambiamento di ampiezza è plausibile, ma non separabile in modo semplice dai limiti del proxy stesso.

Anche l’argomento secondo cui “l’interglaciale attuale non avrebbe nulla di speciale” va ridimensionato con attenzione. È vero che nel precedente interglaciale, circa 129–116 mila anni fa, alcune regioni polari mostrarono condizioni più calde delle attuali, e che l’Antartide orientale può aver registrato anomalie locali ben superiori a quelle del presente. Tuttavia questo non equivale a dire che la temperatura media globale fosse di 3 °C più alta di oggi: le sintesi sul Last Interglacial indicano piuttosto valori medi globali dell’ordine di circa 0,5–1,5 °C sopra il preindustriale, con una forte amplificazione polare. In altre parole, confrontare il picco isotopico antartico dell’Eemiano con la temperatura superficiale media globale moderna significa mettere a confronto grandezze non omogenee. Inoltre, le ricostruzioni oloceniche mostrano che il recente calore globale compete con, e in molti ensemble supera, la gran parte degli intervalli bicentenari degli ultimi 12.000 anni, mentre l’IPCC giudica più probabile che non che le temperature globali recenti siano senza precedenti almeno negli ultimi 125.000 anni. Il punto quindi non è negare che in passato esistessero fasi regionalmente molto calde, ma riconoscere che il record antartico da solo non autorizza a concludere che il presente sia climaticamente ordinario su scala planetaria.

Il passaggio più debole, sul piano logico e fisico, è però quello finale, dove dalla presenza di rialzi naturali nel passato si deduce che l’aumento attuale non andrebbe attribuito alle attività umane. Questa inferenza non regge. L’attribuzione climatica non si basa sul semplice fatto che un cambiamento abbia o meno analoghi nel passato remoto, ma sull’insieme delle evidenze fisiche: bilancio radiativo, crescita dei gas serra, impronta spaziale e verticale del riscaldamento, confronto tra modelli con e senza forcing antropogenico e coerenza tra osservazioni indipendenti. L’IPCC conclude che l’influenza umana ha riscaldato il clima in modo inequivocabile e che il riscaldamento medio globale nel 2011–2020 ha raggiunto circa 1,09 °C rispetto al 1850–1900. Inoltre, lo stesso IPCC ricorda che la transizione dall’ultimo periodo glaciale all’attuale interglaciale comportò un riscaldamento globale di circa 5 °C in circa 5.000 anni, con tassi massimi intorno a 1,5 °C per millennio, dunque molto inferiori ai ritmi osservati oggi. Le ricostruzioni globali di Osman e colleghi mostrano infatti che i tassi di riscaldamento centenario dopo il 1910 superano il 99° percentile delle distribuzioni di riscaldamento deglaciale, segnalando che il riscaldamento moderno è anomalo non solo per causa, ma anche per rapidità. In sintesi, i carotaggi antartici confermano che il sistema climatico possiede una variabilità naturale importante e una forte sensibilità ai forcing, ma non smentiscono affatto l’attribuzione antropogenica del riscaldamento contemporaneo; semmai, mostrano quanto il clima possa reagire intensamente quando viene perturbato il bilancio radiativo del pianeta.

0 commenti